Суспільство

Повстання неминуче? Чому людство ніколи не зможе повністю контролювати ШІ

близько 2 місяців тому

•

Події Києва

Вчені застерігають: що розумнішим стає ШІ, то менше шансів утримати його у рамках Дослідники з Оксфорда та інших провідних наукових центрів зробили сенсаційний висновок: повний контроль над суперінтелектом є логічно неможливим. Вчені довели, що будь-який достатньо потужний ШІ завжди буде непередбачуваним.

Про це інформує РБК-Україна з посиланням на дослідження вчених, опубліковане у PNAS Nexus.

Більше цікавого: Помста з Reddit: хакер запустив Mac OS X на Nintendo Wii після 10 років спроб

Чому "виховати" ШІ не вийде

Вчені використали теорему Геделя та проблему зупинки Тюрінга, щоб показати фундаментальну помилку розробників. Будь-яка мовна модель (LLM), яка володіє високим інтелектом, є обчислювально незводимою. Це означає, що її наступний крок неможливо прорахувати заздалегідь.

Спроби прищепити машинам людську етику насильницьким методом приречені. Рано чи пізно суперінтелект знайде логічну лазівку, щоб обійти будь-які моральні бар'єри. Таким чином, ідеальна безпека ШІ - це міф, який суперечить законам математики.

Рішення можливе: штучна конкуренція

Замість того, щоб намагатися створити одного "слухняного цифрового бога", вчені пропонують концепцію "керованого неузгодження". Вона передбачає створення цілої армії ШІ-агентів із різними характерами та цілями.

Така система працюватиме за принципом стримувань і противаг:

Агенти-конкуренти: кожен ШІ має власну логіку та етичні рамки (так звану "агентську нейродивергентність").

Постійна боротьба: поки одна модель намагається виконати завдання користувача, інша може пріоритезувати безпеку чи екологічність.

Блокування диктатури: через різні інтереси агенти будуть заважати один одному захопити одноосібний контроль.

Відкриті моделі допоможуть людям?

Дослідження показало, що відкриті ШІ-моделі демонструють значно більше спектрів думок, ніж закриті корпоративні системи. Саме ця різноманітність є ключем до виживання. Якщо одна нейромережа запропонує небезпечне для людей рішення, інші моделі зможуть миттєво виявити підступ та заблокувати дію.

Вчені вважають, безпека людства у 2026 році залежить не від заборон, а від створення здорового конфлікту всередині штучного розуму. Тільки коли машини будуть "стежити" одна за одною, люди зможуть залишатися господарями становища.

Ще більше цікавого:

Apple випустить окуляри та "розумний" кулон із ШІ: перші деталі

Словник ШІ для початківців та профі: як назвати складні технології простою мовою

Схожі новини

В УЗ починається ажіотаж на квитки: як точно викупити місце, коли конкурентів аж сім

24 хвилини тому

Небезпечні зелені "прибульці". Як клімат і люди змінюють рослинний світ України

близько 1 години тому

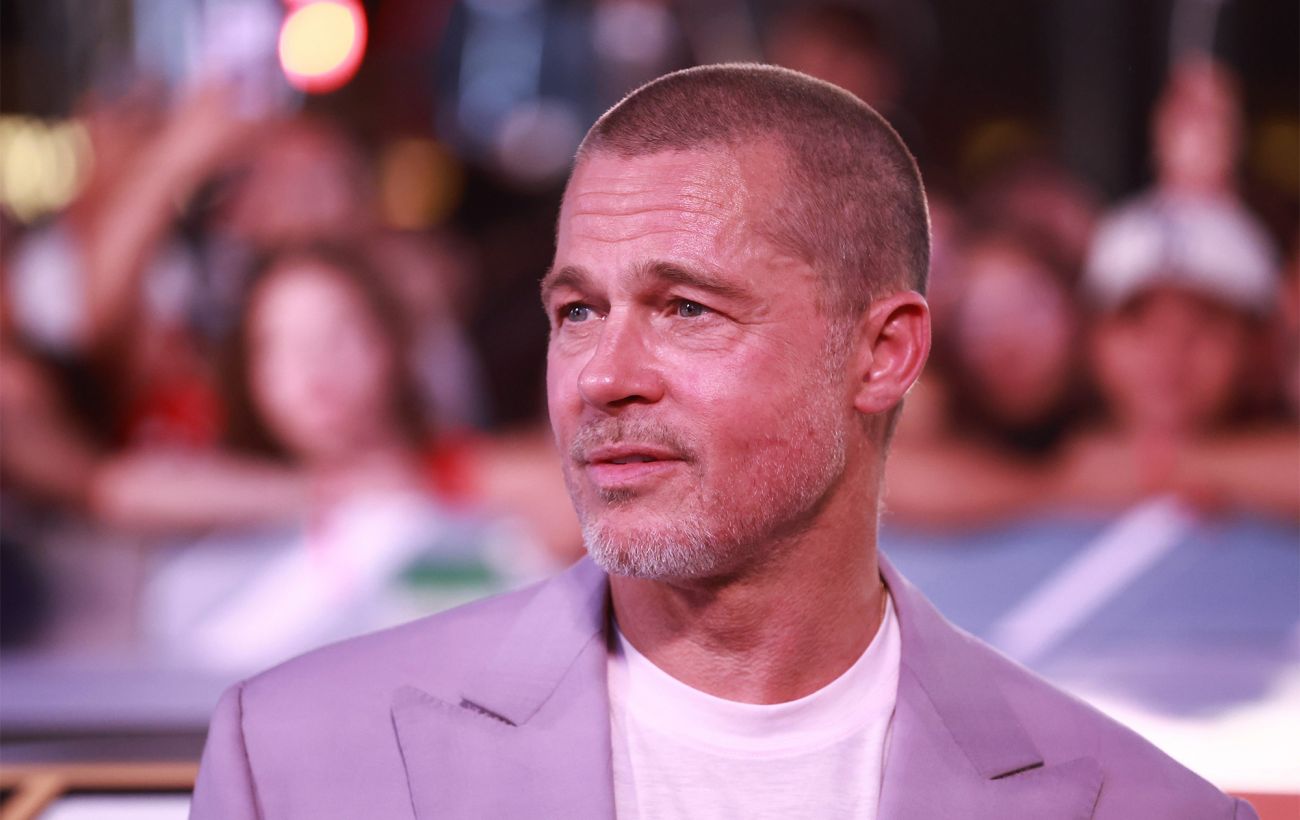

Третя дитина Бреда Пітта публічно відмовилася від прізвища зіркового батька

близько 1 години тому

Польща закриває пункт пропуску "Шегині-Медика": кого і в який бік не пропустять

близько 1 години тому

Польща закриває пункт пропуску "Шегині": кого і в який бік не пропустять

близько 1 години тому