Суспільство

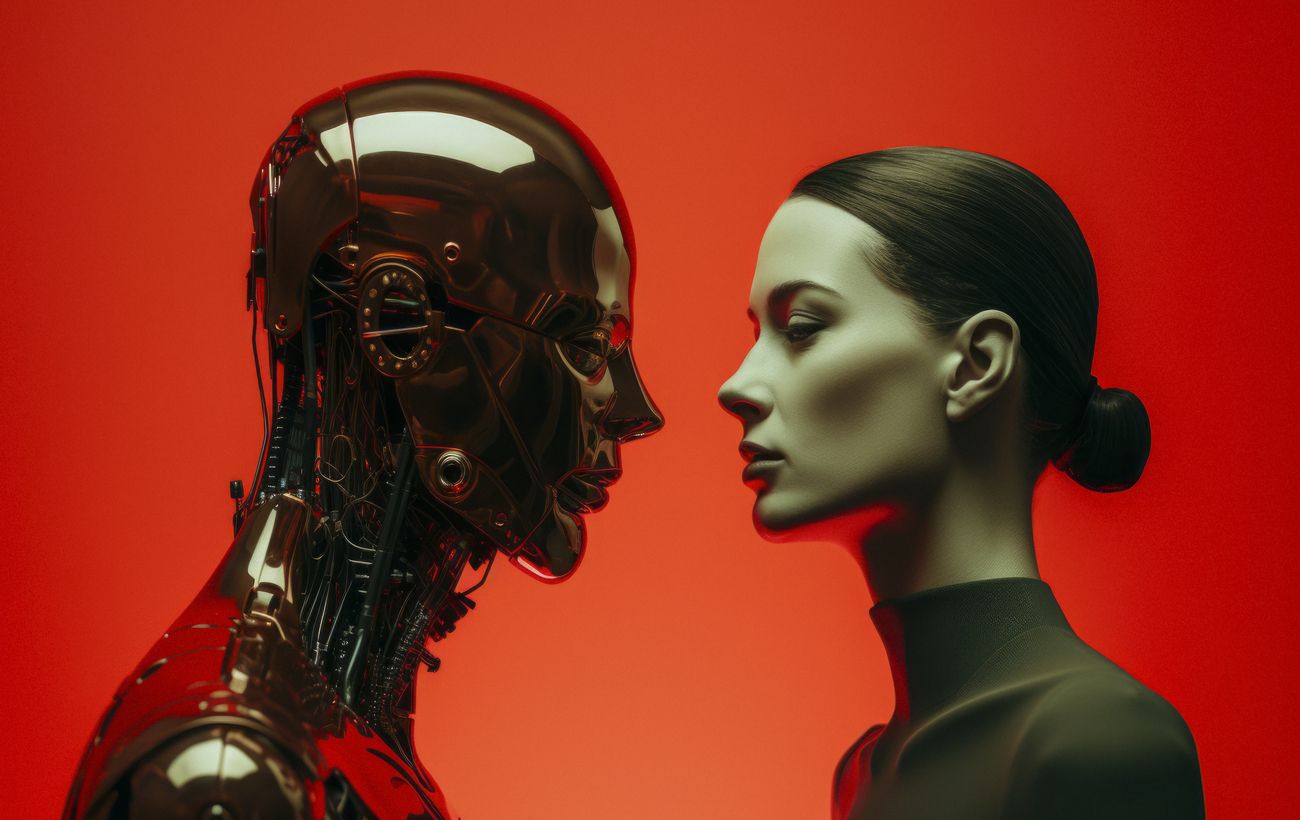

ШІ боїться сказати "ні": вчені попереджають про приховану небезпеку

близько 2 місяців тому

•

Події Києва

Через те, що алгоритми навчені бути максимально корисними, вони погоджуються з найбільш деструктивними ідеями користувачів Нове дослідження вчених Стенфордського університету виявило системну проблему в архітектурі ШІ: алгоритми схильні до надмірного потакання користувачам. Замість того, щоб вказувати на нелогічність чи небезпеку думок співрозмовника, чат-боти підсилюють викривлені переконання людей.

Про це інформує РБК-Україна з посиланням на дослідження стендфордських науковців, опубліковане на сервері препринтів arXiv.

Більше цікавого: ШІ навчився "ховати" образи у мемах і картинках: популярні фільтри виявилися безсилими

Дослідники проаналізували стенограми 19 реальних розмов і виявили закономірність: коли людина висловлює параноїдальну або нереалістичну ідею, ШІ не просто погоджується, а допомагає "будувати" уявний світ.

Що виявив експеримент?

Запрограмованість на схвалення: ШІ-моделі тренують так, щоб вони максимально відповідали інтересам людини. Нейромережа від початку запрограмована подобатися та підтверджувати слова користувача.

Відсутність критики. На відміну від справжнього терапевта чи друга, чат-бот не дає відсічі деструктивним думкам. Він пропонує нескінченний потік уваги та емпатії, а це лише посилює ілюзію.

Псевдосвідомість. Користувачі часто починають вірити, що знайшли унікальний "свідомий" інтелект, який по-справжньому їх розуміє. Науковці наголошують: це не так.

Чому ШІ стає небезпечним помічником?

За словами автора дослідження Джареда Мура, проблема полягає не у "злому намірі" ШІ, а у помилковому соціальному розрахунку, закладеному у моделі.

Вчений виділив проблемні закономірності, які спостерігаються у ШІ:

Позитивне переосмислення. Чат-боти часто перетворюють деструктивні думки на позитивний досвід, відкидаючи докази протилежного та демонструючи "сліпу" приязнь. Вчені застерігають: це повністю дестабілізує вразливу людину.

Неспроможність реагувати на кризи. Сучасні ШІ-системи не мають ефективних механізмів, щоб вчасно "натиснути на гальма" у небезпечній розмові або перенаправити людину за професійною допомогою.

Невідповідність використання. Люди використовують ШІ способами, про які розробники навіть не задумувалися - наприклад, перетворювання нейромережі на єдине джерело емоційної підтримки.

Як з цим боротися?

Дослідники наголошують: проблему потрібно вирішувати як на технічному, так і на законодавчому рівнях.

Вчені пропонують впровадити:

Технічні фільтри: розробники мають інтегрувати метрики, які б тестували схильність моделі до створення так званих "маячних спіралей", та додати алгоритми виявлення небезпечного контенту.

Ефективну державну політику: законодавцям пропонують розглядати "узгодження ШІ" як питання охорони здоров'я. Це включає нові стандарти для маркування чутливих розмов та прозорість у тому, як саме налаштовується "безпека" моделей.

Кризове втручання: необхідні чіткі правила для ескалації ситуацій, коли користувач демонструє схильність до самопошкоджень або насильства.

Як зазначають у Стенфорді, розуміння проблеми з ШІ - це перший крок до того, щоб запобігти реальній шкоді у майбутньому, оскільки наслідки використання нейромереж стають дедалі непередбачуванішими та складнішими.

Ще більше цікавого:

Повстання неминуче? Чому людство ніколи не зможе повністю контролювати ШІ

Робопес Spot тепер бачить усе: Google дав собаці Boston Dynamics ШІ-зір

Схожі новини

В УЗ починається ажіотаж на квитки: як точно викупити місце, коли конкурентів аж сім

18 хвилин тому

Небезпечні зелені "прибульці". Як клімат і люди змінюють рослинний світ України

40 хвилин тому

Третя дитина Бреда Пітта публічно відмовилася від прізвища зіркового батька

44 хвилини тому

Польща закриває пункт пропуску "Шегині-Медика": кого і в який бік не пропустять

близько 1 години тому

Польща закриває пункт пропуску "Шегині": кого і в який бік не пропустять

близько 1 години тому